Утром запустил Claude Code как обычно. В шапке терминала: Opus 4.7 (1M context) with xhigh effort. Апгрейд прокатили тихо, без уведомлений в самом приложении. Параллельно Anthropic обнулил weekly limits для всех подписчиков пару часов назад (подтвердили ребята в чатах). Дефолт effort level в Claude Code подняли до xhigh для всех планов (на API по-прежнему дефолт high, xhigh надо ставить явно). Новость о релизе и сам релиз свалились одновременно.

Прогнал через свои задачи: контент, скиллы, автоматизации, правки на сайте, планирование нового функционала, разработка. Собрал всё важное в одном месте: что поменялось под капотом, что стало лучше, где подвохи, что ломает старые промпты и что делать с миграцией.

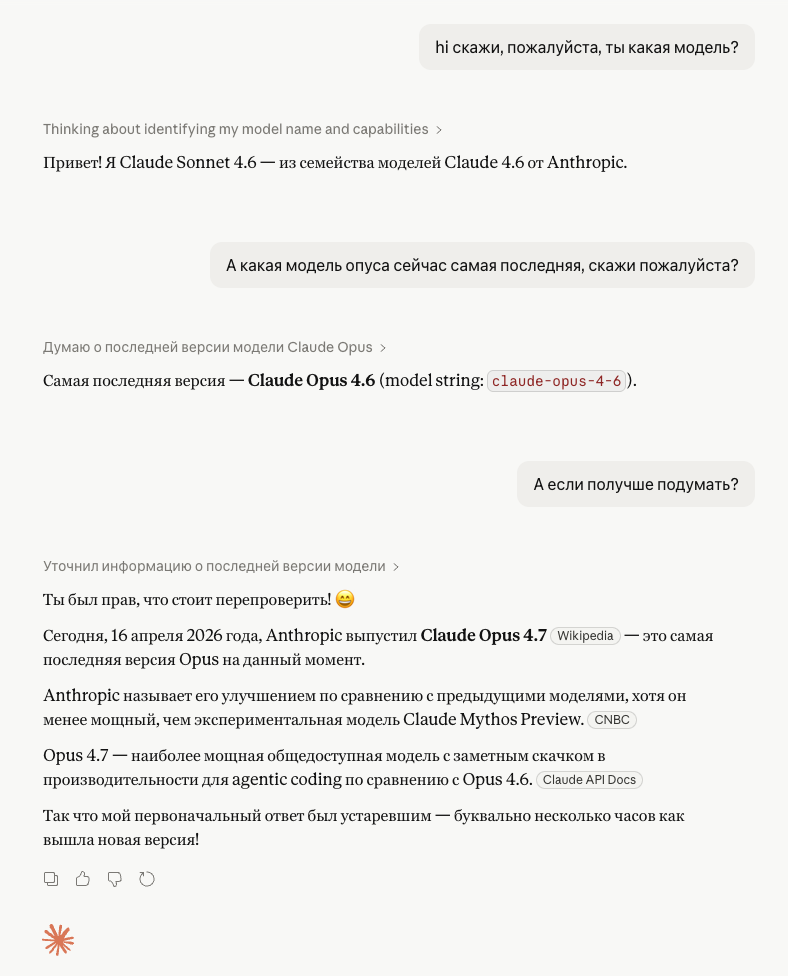

Что вообще вышло

Claude Opus 4.7, API model ID claude-opus-4-7. Доступно на Claude.ai (Pro/Max/Team/Enterprise), в Claude Code, через Messages API, на Amazon Bedrock, Google Vertex AI, Microsoft Foundry. Цена та же что у 4.6: $5/MTok на вход, $25/MTok на выход, до 90% экономии на prompt caching. 1M context window без long-context премии. 128k max output.

Важный контекст: 4.7 это не Mythos Preview. Та модель действительно мощнее (77.8% на SWE-bench Pro против 64.3% у 4.7), но заперта в Project Glasswing и доступна только партнёрам с верификацией. 4.7 первая модель, обученная с cyber safeguards: во время обучения Anthropic специально глушили cyber-capabilities, плюс в runtime включили автоматическую блокировку запросов по prohibited темам.

Релиз пришёл после нескольких недель публичных жалоб на регрессию 4.6 (AMD senior director и другие писали про “Claude can’t be trusted anymore”). Фраза Anthropic “previously needed close supervision” по сути признание: 4.6 к апрелю стал хуже, чем был в январе. 4.7 возвращает доверие на уровень, с которого можно хэндить сложную работу.

Что реально стало лучше

Инструкции выполняются буквально. У меня в CLAUDE.md есть жёсткие правила: не коммитить автоматически без подтверждения, проверять статусы в 4 репозиториях перед push, соблюдать конкретные конвенции именования. На 4.6 часть этих правил терялась в середине долгой сессии, приходилось повторять. На 4.7 срабатывают стабильно. Anthropic прямо пишут: модель больше не обобщает инструкции с одного пункта на другой и не делает того, о чём не просили. Для production это плюс, для старых нечётких промптов повод для аудита.

Планирование стало подробнее без дополнительных шагов. 4.6 с plan mode работал хорошо, но для сложных фич я обычно добирал детали ещё одним кругом уточнений либо прогонял через brainstorm. На 4.7 заметил, что план собирается плотнее с первого прохода: эпик, подзадачи, архитектурные развилки, контекст из CLAUDE.md подтягивается сам. Разница ощутимая именно на длинных пайплайнах, где раньше экономил один круг prompting.

Vision: 2576px против 1568px. Трёхкратный прирост разрешения (с 1.15MP до 3.75MP). Для computer use и скриншотов критично: дашборды с мелким шрифтом, dense UI, таблицы с данными теперь читаются без даунскейла. XBOW в своём computer-use бенчмарке получили 98.5% visual acuity против 54.5% на 4.6. Бонусом: координаты pointing и bounding-box теперь 1:1 с пикселями изображения, никаких scale-factor пересчётов.

Память на файловой системе. Модель лучше пишет заметки в CLAUDE.md / MEMORY.md / per-topic файлы и лучше поднимает их в новых задачах. Правила меньше теряются после compaction. Anthropic упомянули feature Dreaming, которая конвертирует короткую память в длинную (пока в превью).

Knowledge work. Заявлено и подтверждается: .docx redlining, .pptx editing, программный анализ графиков через PIL с pixel-level data transcription. На GDPval-AA (третий-пати eval экономически ценной knowledge work) 4.7 показал 1753 Elo против 1674 у GPT-5.4. Если в промпте были костыли типа “перепроверь layout слайда перед возвратом”, Anthropic советуют их убрать: теперь модель это делает сама.

Бенчмарки без завышения:

- SWE-bench Verified: 87.6% (4.6 был 80.8%)

- SWE-bench Pro (contamination-resistant): 64.3% против 53.4% (+10.9 pp, один из самых больших single-release прыжков)

- CursorBench: 70% против 58%

- Rakuten-SWE: 3x больше resolved production tasks

- Terminal-Bench 2.0: 69.4% против 65.4% (всё ещё уступает GPT-5.4 с 75.1%)

- Notion Agent: +14% с 1/3 tool errors

- XBOW visual acuity: 98.5% против 54.5%

- CodeRabbit recall: +10%, precision стабильна

Даже с поправкой на “partners cherry-pick результаты” цифры выглядят честно, особенно SWE-bench Pro (она чистится от memorization).

Где насторожило

Скорость ниже. 4.7 заметно медленнее 4.6. Причина не секрет: adaptive thinking теперь единственный режим, и модель реально перепроверяет промежуточные шаги. Anthropic честно пишут: “thinks more at higher effort levels, particularly on later turns in agentic settings”. Для 5-минутной задачи это лишние 40-60 секунд. Для долгой агентной сессии плюс 10-20%. Размен: надёжность на hard problems. Если вы платите за скорость interactive UX, это минус. Если за автономность в долгих задачах, это плюс.

Токены жгутся быстрее. Тут сразу несколько факторов:

- Новый tokenizer: тот же текст мапится в 1.0-1.35x больше токенов. Зависит от контента: код с нелатинскими символами ближе к 1.35x, обычный английский ближе к 1.0x.

xhighдумает сильно большеhigh. В Claude Codexhighтеперь дефолт для всех планов.- Full-resolution изображения используют до 3x больше токенов (до 4784 токенов на картинку против 1600 раньше).

Цена за токен не поменялась, но эффективная стоимость workflow выросла на 20-30%. Hex замеряли полезный side-effect: low-effort 4.7 примерно эквивалентен medium-effort 4.6. Это путь компенсации, если задача не требует top-tier reasoning.

Отдельно про max effort и лимиты. Здесь важно не перепутать названия: подписка Max ($100-200/мес) и max effort level это разные вещи, которые неудачно совпали по имени. Проблема именно с effort-уровнем max. С марта в GitHub issues Claude Code и на Reddit массовый сигнал: один агентный запуск на max effort может выжечь пятичасовое окно подписки за 1-2 промпта. На high и xhigh такого обычно не происходит, именно max даёт этот эффект. Частично история тянется с бэкграунд-багов (cache_read, закрыт в 2.1.91) и peak-hour throttling (5-11 AM PT, с марта), но с 4.7 max стал острее: tokenizer даёт до +35% токенов на том же тексте, adaptive thinking перепроверяет промежуточные шаги, subagents на max умножают расход. Если экспериментируете с max - проверяйте /usage сразу после каждого такого запуска, не ждите конца сессии.

Day 1 баг в Claude Code. Auto mode в версии 2.1.111 сломался: safety classifier возвращал claude-opus-4-7 temporarily unavailable на любой bash-запрос. Блокировал не только write-операции, но и чтения. Фикс в 2.1.112 выкатили к вечеру. Если обновлялись утром, проверьте claude --version.

Cyber safeguards режут часть задач. 4.7 первая модель с real-time блокировкой по киберугрозам. Если у вас в продукте легитимный pentest, vulnerability research, red team, вас будут блочить. Для таких кейсов есть Cyber Verification Program, но процесс небыстрый.

Breaking changes на API

Если дёргаете модель напрямую через Messages API (не через Claude Code или Managed Agents):

-

temperature,top_p,top_kтеперь дают 400. Убирайте из payloads полностью. Для предсказуемости поведения используйте prompting, а не sampling params (они и раньше не гарантировали идентичные аутпуты). -

Extended thinking budgets убрали.

thinking: {"type": "enabled", "budget_tokens": N}возвращает 400. Нужно переходить на adaptive thinking:thinking: {"type": "adaptive"}+output_config: {"effort": "high"}. Adaptive thinking OFF by default, нужно явно включать. -

Thinking content по умолчанию не приходит.

displayтеперь"omitted"по дефолту. Если в UI показываете reasoning, ставьтеdisplay: "summarized", иначе увидите долгую паузу перед output без progress indicator. -

Prefill убрали (перенос с 4.6). Pre-filling assistant messages возвращает 400. Используйте structured outputs, system prompt, или

output_config.format. -

Новый tokenizer.

/v1/messages/count_tokensдля одного и того же текста вернёт другое число против 4.6. Любой клиентский код, который оценивает токены по character ratio или cached числам, нужно ретест. -

max_tokensрекомендуют поднять. Для xhigh/max effort Anthropic советуют стартовать с 64k output tokens, чтобы у модели был headroom на thinking + subagents.

В Claude Code есть автомиграция: запустите /claude-api migrate внутри проекта, скилл пройдётся по кодовой базе и применит model swap, параметры, effort calibration.

Behavior changes (не breaking, но аудитить нужно)

Это не ломает API, но может сюрпризнуть в проде:

- Response length калибруется по сложности задачи, а не по фиксированной verbosity. Простые запросы будут короче, сложный анализ длиннее. Если вы завязаны на определённую длину ответа, пропишите это явно.

- Модель делает меньше tool calls по дефолту, больше опирается на reasoning. Чтобы увеличить tool use, поднимайте effort до

highилиxhigh. - Модель спавнит меньше subagents по дефолту. Если нужен параллельный fan-out, укажите это явно.

- Tone стал прямее. Меньше validation-forward phrasing (“great question!”), меньше эмоджи, более opinionated. Если продукт завязан на warm tone 4.6, нужен style prompt.

- Progress updates встроены в долгие агентные сессии. Если в промпте были костыли типа “every 3 tool calls summarize progress”, уберите, теперь модель делает это сама.

- Stricter effort calibration. На

lowиmediumмодель scope’ает строго под запрос, не берёт “чуть больше”. Наlowесть риск under-thinking на умеренно сложных задачах: поднимайте effort, не пытайтесь обмануть промптом.

Effort levels - как выбирать

Это самое важное для migration. Anthropic прямо пишут: “effort будет важнее для этой модели, чем для любого prior Opus”. Прогоните рекомендации под свой workload:

xhigh(новый) - лучший выбор для большинства coding и agentic кейсов. В Claude Code теперь дефолт для всех планов (на API дефолт осталсяhigh,xhighнадо ставить явно). Стартовая точка для большинства задач.high- баланс токенов и интеллекта. Минимум для intelligence-sensitive use cases. Хорош для интерактивной работы, где важна скорость отклика.medium- cost-sensitive, жертвуете частью интеллекта ради токенов. Простой код, рутинные правки, содержательные summaries.low- только для коротких scoped задач и latency-sensitive workloads. Классификация, extraction, формат-транспортеры.

Отдельно про max. Это не “включи на всё подряд, там же больше ума”. Anthropic и независимые бенчмарки замеряли: на max начинается overthinking даже на простых задачах, diminishing returns после определённого порога, токены улетают в thinking блоки без пользы для ответа. Плюс именно max чаще всего ловит описанный выше сценарий “одна задача выжгла пятичасовой слот”.

Когда max реально оправдан:

- Архитектурные решения, где ошибка стоит дорого (схема БД, API контракты, concurrency).

- Трудные баги с race conditions, который на более низком effort модель пропускает.

- Security review и audit, где важнее thoroughness, чем время.

- Новая незнакомая область, где модель должна исследовать пространство решений.

- Долгие автономные задачи, где отсутствие supervision компенсируется глубиной reasoning.

Когда max не нужен: feature additions, рефакторинг понятной структуры, написание тестов, документация, обычный bugfix с ясным воспроизведением. Держите дефолт на xhigh, эскалируйте на max осознанно под конкретный тип работы.

Практический совет: стартуйте с xhigh, замеряйте качество/стоимость на своём evalе. Не пытайтесь сэкономить на low для сложных задач, сломаете reasoning. Не пытайтесь “улучшить” простые задачи через max, сожжёте лимит.

Новые инструменты, которые реально полезны

Task budgets (beta). Advisory token budget на весь агентный цикл: thinking + tool calls + final response. Модель видит running countdown и сама решает, когда закругляться. Минимум 20k токенов. Это не hard cap (в отличие от max_tokens), а рекомендация модели. Включается через header task-budgets-2026-03-13.

output_config = {

"effort": "high",

"task_budget": {"type": "tokens", "total": 128000},

}Когда не использовать: open-ended задачи, где качество важнее скорости. Когда использовать: долгие пайплайны, где нужен контроль расхода без жёстких timeout.

/ultrareview в Claude Code. Отдельная сессия, которая читает diff и флажит баги как старший инженер на PR review. Не линтер, реальный design review. Pro и Max получают 3 бесплатных ultrareview для теста. После трёх расходует обычный токен бюджет. Интересно попробовать как pre-commit gate на сложных фичах.

Auto mode для Max. Модель сама решает, когда спрашивать разрешение, когда действовать. Это не bypass-permissions (где она вообще молчит), а промежуточный режим с суждением. Полезно для долгих агентных задач: меньше interrupt, но не бесконтрольно. Раскатали для Max пользователей именно сегодня.

Dreaming. Конвертация короткой памяти в длинную. Пока в превью, деталей мало, но направление ясно: делают polished memory store out of the box.

Сравнение с конкурентами (апрель 2026)

Из бенчмарков последних дней:

- Opus 4.7 берёт agentic coding (SWE-bench Pro 64.3%), visual acuity на pen-testing (XBOW 98.5%), long-running agentic tasks, MCP-Atlas tool-use первое место.

- GPT-5.4 берёт terminal-bench (75.1% против 69.4% у Opus 4.7), OSWorld computer-use (75%, первый кто превысил human baseline 72.4%), pure math (MATH/AIME), GDPval knowledge work (83%). Дешевле Opus: $2.50/$10 за 1M.

- Gemini 3.1 Pro берёт multimodal breadth (до 8.4ч аудио, 1ч видео, images, PDF в одном запросе), reasoning-бенчмарки (GPQA Diamond 94.3%, ARC-AGI-2 77.1%). Контекст 1M, как у Opus. Самый дешёвый из трёх: $2/$12 за 1M.

Большинству из нас выбирать не пришлось: на подписке 4.7 раскатили автоматически. Полезнее понимать, где 4.7 реально сильнее альтернатив, а где смысл параллельно использовать что-то ещё. Coding, агентные пайплайны и visual acuity на плотных интерфейсах - территория 4.7. Где альтернативы остаются выгоднее: terminal-heavy workflow лучше идёт у GPT-5.4, нативная работа с аудио и видео у Gemini 3.1 Pro, самая низкая цена за токен тоже у Gemini.

Что делать прямо сейчас

- Если вы на Claude Code Max/Pro: продолжайте работать, но проверьте версию (2.1.112+). Auto mode был сломан на 2.1.111.

- Если у вас большой системный промт: прогоните аудит. Literal instruction following ломает места, где “договорились без слов”. Уберите костыли для поведений, которые 4.7 делает нативно (progress updates, self-checking, concise output).

- Если используете API напрямую: обновите thinking config, уберите sampling params, проверьте tokenizer-инфляцию на своём корпусе через

count_tokens. - Если платите по API за heavy workflows: закладывайте +20-30% в бюджет на ближайший месяц. Рассмотрите

low-effort 4.7 ≈ medium-effort 4.6как путь оптимизации.

Sources

- Anthropic: Introducing Claude Opus 4.7

- What’s new in Claude Opus 4.7 (API docs)

- Opus 4.6 → 4.7 migration guide

- Task budgets documentation

- Effort parameter documentation

- Adaptive thinking documentation

- High-resolution image support

- Auto mode bug (Claude Code #49254, fixed in 2.1.112)

- Implicator.ai: coding benchmarks comparison

- Decrypt: first review with token-usage observations

- Cyber Verification Program